Casi desde el inicio de los ordenadores, los ingenieros han trabajado para desarrollar mejores formas de interacción entre los humanos y la tecnología. Hasta las interaciones más recientes de la pantalla táctil, la mayoría de las interfaces entre los seres humanos y los ordenadores eran un compromiso entre la facilidad de uso y el control granular. La pantalla táctil ofrecía un método de control mucho más natural e intuitivo que hasta a un niño puede aprender fácilmente. Evidentemente, las pantallas táctiles no son ideales para todas las aplicaciones. Añaden costes a las aplicaciones económicas, su uso en dispositivos más pequeños es incómodo, son un punto débil para las instalaciones en exteriores (tanto debido al medio ambiente como al vandalismo), pueden representar una amenaza a la seguridad, y, por supuesto, la proximidad física es esencial para la interacción. En casos como estos, los diseñadores necesitan una forma de controlar de forma intuitiva la tecnología sin las desventajas. Para esas aplicaciones y muchas otras, el reconocimiento y control de voz puede ser la tecnología perfecta. No hay nada nuevo en sí en la idea de controlar la tecnología por medio de la voz. Desde el inicio de la era de la informática, se ha intentado aprovechar las capacidades del habla. Estos intentos habían tenido varios grados diferentes de éxito hasta hace poco, cuando se combinaron los grandes avances en los algoritmos de reconocimiento de voz con las capacidades informáticas a gran escala para hacer posible que los diseñadores creen una tecnología que responda de forma rápida y precisa a una gran variedad de comandos. Bell Laboratories realizó el primer intento de crear un ordenador que entendiera el habla humana en 1952.

El sistema, llamado Audrey, era muy básico y solo podía entender unos pocos comandos de personas específicas. El reconocimiento de voz mejoró de forma incremental hasta los años 1970 cuando el Departamento de Defensa de EE. UU. llevó a cabo el programa DARPA de investigación sobre la comprensión de la voz (SUR por sus siglas en inglés). DARPA SUR fue un gran proyecto realizado entre 1971 y 1976. La investigación llevó eventualmente al desarrollo del sistema Harpy de Carnegie Mellon que contaba con un vocabulario de más de mil palabras. En vez de ser simplemente una evolución de los sistemas anteriores, Harpy utilizaba un nuevo enfoque de investigación innovador mucho más eficiente que los sistemas de investigación anteriores. El algoritmo de Beam Search podía predecir una red finita de frases posibles. Los años 1980 trajeron consigo grandes avances en el reconocimiento de voz mediante el desarrollo del Hidden Markov Model (HMM), una técnica de modelos estadísticos que podían predecir si los sonidos individuales podían tratarse de palabras. Este adelanto amplió a varios miles la cantidad de palabras que un ordenador podía aprender. El siguiente gran avance tecnológico tuvo lugar en 1997 cuando se lanzó el primer sistema que podía entender el habla natural. Dragon Naturally Speaking podía procesar cerca de 100 palabras por minuto. Estos avances cimentaron las bases del reconocimiento de voz.

Lo que se necesitaba para generalizar el uso de la tecnología era una informática económica, ampliamente disponible y a gran escala, que ofreciera respuestas en tiempo real para el control. Esto tuvo lugar más recientemente gracias a dos gigantes del sector: Google y Apple. En 2011, Apple lanzó Siri, el asistente personal digital inteligente de la empresa en el iPhone 4S. Siri incorporó al sistema un nivel de control del usuario, permitiendo a los usuarios hacer llamadas, dictar mensajes o reproducir música usando control de voz. En 2012, la app Voice Search de Google, desarrollada originalmente para el iPhone de Apple, aprovechó la conectividad inherente de los teléfonos para comparar las frases de búsqueda con los datos de las búsquedas de usuario que la empresa había acumulado en la nube. La capacidad de comparar con búsquedas anteriores fue un gran adelanto en el nivel de precisión, ya que permitía que la inteligencia artificial entendiera mejor el contexto de la búsqueda. En realidad, Google Search y Siri eran un medio secundario de control tras las pantallas táctiles. Amazon llevó el concepto a otro nivel con su Echo que combinaba un asistente personal digital con un altavoz dejando atrás la pantalla táctil.

Con el éxito de los asistentes personales digitales inteligentes, cada vez más diseñadores y aficionados consideran el reconocimiento y control de voz como una opción viable para su próximo diseño. ABI Research, analistas del sector, concuerdan al estimar que se venderán 120 millones de dispositivos de activación por voz para el 2021 y que el control de voz será una interfaz de usuario clave para la domótica. Los diseñadores que desean incorporar el control de voz a sus productos, deben tener en cuenta algunas cosas. Es posible construir todo el sistema desde cero para que funcione offline, pero eso solo ofrecerá una funcionalidad relativamente limitada. Los algoritmos y las bibliotecas de reconocimiento de voz tendrán limitaciones de memoria, e incorporar nuevos comandos podría ser difícil. Aun así, es posible. PocketSphinx ha desarrollado diseños para dispositivos Android y la versión más reciente se puede usar como un app independiente en muchos dispositivos con Android Wear 2.0. No obstante, la mayoría de los diseñadores querrá ofrecer un conjunto de instrucciones completo, lo que requiere conexión con la nube. La mayoría de los grandes proveedores de servicios de nube, incluyendo Amazon y Google, ofrece herramientas de voz como un servicio, que pueden incorporarse de forma relativamente económica a los diseños. Como en el caso de cualquier decisión de diseño, la mejor opción de servicio dependerá de sus prioridades.

Por ejemplo, IBM también ofrece un servicio de voz como parte de la plataforma Watson Cloud de la empresa. La plataforma es flexible, pero puede interesarles más a quienes quieren aprovechar la experiencia analítica de IBM que ha quienes quieren una plataforma más generalizada centrada en el consumidor. Tanto Amazon como Google ofrecen una plataforma a medida para el mercado general de la domótica. Ambas empresas han creado un ecosistema que incluye algunos de los diseñadores más respetables de productos de domótica. Los socios de Amazon incluyen dispositivos de Nexia, Hue de Philips, Cree, Osram, Belkin y Samsung. Google comparte muchos de los mismos socios con Amazon, incluyendo Hive, Nest, Nvidia, Hue de Philips y Belkin. Para ayudar a incorporar el control de voz de Amazon y Google a sus productos, las dos empresas ofrecen acceso a sus plataformas a un precio relativamente bajo.

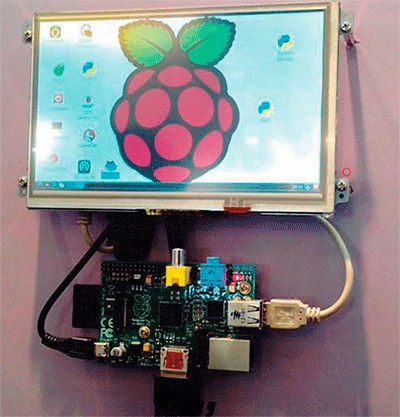

El servicio de voz Alexa (AVS) de Amazon permite a los diseñadores integrar a Alexa directamente en sus productos. AVS ofrece un conjunto completo de recursos que incluye API, kits de desarrollo de software y hardware y documentación. Google también permite a los diseñadores utilizar la funcionalidad del asistente personal digital inteligente de la empresa, Google Assistant, mediante un kit de desarrollo de software, que ofrece dos opciones para integrar el asistente: la biblioteca de Google Assistant y la API gRPC de Google Assistant. La biblioteca de Google Assistant está escrita en Python y funciona en dispositivos con arquitecturas linux-ARM v7l y linuxx86_ 64 (como los escritorios de Raspberry Pi 3 B y Ubuntu). La biblioteca ofrece una API de alto nivel basada en eventos que se pueden extender fácilmente. La API gRPC de Google Assistant ofrece acceso a una API de bajo nivel. Es posible generar <1>bindings</1> para esta API para lenguajes como Node.js, Go, C++, Java para todas las plataformas que soportan gRPC. Para quienes prefieren evitar estos servicios o utilizar una interfaz de código abierto, hay otras opciones disponibles.

Por ejemplo, Mycroft es un asistente personal inteligente gratuito y de código abierto para sistemas operativos basados en Linux, que utiliza una interfaz de usuario de lenguaje natural. Mycroft también es una aplicación modular, lo que permite a los usuarios cambiar sus componentes. Jasper es otra opción de código abierto que permite a los diseñadores incorporar fácilmente nuevas funcionalidades al software. En lo que respecta al hardware, el host más probable será un ordenador de placa como Raspberry Pi. Existen algunas placas diseñadas específicamente para aplicaciones de control de voz, como la placa Matrix Creator que puede funcionar como placa complementaria de la Raspberry Pi o de forma independiente. La placa cuenta con una matriz de siete micrófonos MEMS para ofrecer un campo de escucha de 360o. La placa se basa en un núcleo ARM Cortex M3 con SDRAM de 64 Mbit. También incorpora una variedad de sensores para permitir a los diseñadores añadir funcionalidades. Los servicios listos para usar con la placa incluyen AVS de Amazon, la API de reconocimiento de voz de Google y Houndify. Obviamente, los micrófonos son una consideración de diseño muy importante. Con frecuencia se usan varios micrófonos distribuidos en una matriz para capturar una representación más exacta del sonido. Si no se integra a la matriz la tecnología para consolidar los sonidos de los diferentes micrófonos, puede requerir labores de diseño así como capacidad de procesamiento adicionales. La tecnología de reducción del ruido también es extremadamente importante para garantizar la recepción precisa de las instrucciones.

Conclusión

El Santo Grial para los diseñadores es desarrollar la interfaz más intuitiva posible entre los seres humanos y las máquinas. No existe ninguna interfaz que se pueda comparar con el método instintivo en que los humanos se comunican entre sí. El control de voz ha llegado a un punto en que el proceso es tan natural como hablar con otro ser humano. Pese a que los precursores de la tecnología fueron algunas de las grandes empresas del sector, ahora está disponible para que todos los diseñadores la usen en sus diseños. Como gran parte del procesamiento pesado se realiza en la nube, el hardware requerido no es tan exigente como se podría pensar. También existen placas, herramientas y servicios especializados que están ampliamente disponibles para simplificar de forma drástica el proceso, lo que significa que se puede añadir el control de voz a casi cualquier proyecto.