Un gran error consiste en pensar que los datos de prueba son puramente válidos o no válidos, pero esto no podría estar más lejos de la verdad. A pesar de que los instrumentos tradicionales de funcionalidad fija, sólo envían los resultados al PC principal del sistema de prueba, hay una gran cantidad de procesamiento de señales escondido bajo su carcasa de plástico. El procesador dentro del instrumento determina la velocidad de medida. Esto es especialmente cierto en el procesamiento de señales en el caso de medidas intensivas de aplicaciones tales como RF, sonido y vibración, y en los osciloscopios basados en formas de onda.

Por ejemplo, incluso los analizadores de espectro basados en FFT más rápidos del mercado siguen dedicando en realidad sólo el 20 por ciento de su tiempo a adquirir la señal; más del 80 por ciento restante se invierte en el procesamiento de la señal mediante un algoritmo dado. Si se aplica esto a un instrumento lanzado al mercado hace cinco años, el desglose es aún peor.

El procesamiento de la señal puede llegar a dominar hasta el 95 por ciento del tiempo de la medida. Debido a que la inversión anual en un nuevo conjunto de instrumentos no es una opción, la utilización de equipos de prueba anticuados para probar dispositivos modernos y complejos es una realidad. La mayoría de los departamentos de prueba terminan con una gran diferencia de rendimiento entre la potencia de procesamiento de sus sistemas y sus necesidades verdaderas de procesamiento.

Los sistemas de prueba basados en módulos cuentan con tres grandes y separadas partes: el controlador, el chasis y la instrumentación. El controlador funciona como un PC industrial y contiene la CPU del sistema. La principal ventaja de este método consiste en la posibilidad de sustituir la CPU con la más reciente tecnología de procesamiento y mantener los componentes restantes (chasis/placa madre e instrumentación) del sistema de prueba. En la mayoría de los casos de uso, el mantenimiento de instrumentación y la mejora de la capacidad de procesamiento alargan la vida del sistema de prueba modular mucho más allá de la de un instrumento tradicional.

Tanto los instrumentos modulares como los tradicionales se basan en los mismos avances de la tecnología del procesador para incrementar la velocidad de la prueba, pero los sistemas modulares son mucho más ágiles y económicos de mejorar que los instrumentos tradicionales.

Los cambios en el mercado de procesadores

En 2005, Intel lanzó el primer procesador multinúcleo, el procesador Intel®Pentium®D, destinado al mercado general. Acostumbrados a aprovechar la potencia de los procesadores cada vez más rápidos, los desarrolladores de software se vieron obligados a considerar nuevas técnicas de programación en paralelo para seguir cosechando las ventajas de la ley de Moore. Como explicaba Geoffrey Moore en su libro “Cruzando el abismo” (Crossing the Chasm), la adopción de tecnología sigue una curva de campana con respecto al tiempo y cuenta con cinco estados que participan progresivamente: los innovadores, los primeros en la adopción, la mayoría temprana, la mayoría tardía y los rezagados. Ciertas industrias, como las de juegos y procesamiento de vídeo, se apresuraron a adoptar técnicas de programación en paralelo, mientras que otras industrias han sido más lentas en instaurarlas.

Desafortunadamente, los ingenieros de pruebas automatizadas entran en la categoría de la mayoría tardía cuando se trata de la adopción de técnicas de programación en paralelo.

Esto podría atribuirse a multitud de razones, pero tal vez la razón más importante es que no tenían ningún incentivo para rediseñar su arquitectura de software para los procesadores multi-núcleo. Hasta ahora, los ingenieros de prueba más automatizados han utilizado una tecnología como la Intel Turbo Boost para incrementar la velocidad de un solo núcleo en un procesador de cuatro núcleos y reducir los tiempos de prueba de las arquitecturas de software secuenciales, pero esta tecnología está estancada. Muchos factores, como la disipación de calor, están impidiendo que la velocidad del procesador se incremente sobre sus valores anteriores. Para mantener el consumo de energía mientras se incrementa el rendimiento, Intel y otros fabricantes de procesadores están recurriendo a la tecnología de múltiples núcleos, como se ve en el procesador Intel®Xeon® que cuenta con ocho núcleos lógicos.

El resultado es un procesador con velocidad de reloj similar al procesador anterior, pero con un incremento del número de núcleos computacionales que pueden “triturar” datos.

Aplicaciones preparadas para muchos núcleos de procesadores

Ciertas áreas de aplicación de las pruebas son las principales candidatas para aprovechar la potencia de las tecnologías de procesadores de múltiples núcleos.

En The McClean Report 2015, los investigadores de IC Insights examinan muchos aspectos del mercado de semiconductores, incluyendo los aspectos económicos de la empresa. Ellos afirman: “En el caso de algunos chips complejos, los costes de las pruebas pueden ser de hasta la mitad del coste total … los tiempos de prueba más largos están haciendo subir los tiempos de las pruebas”. Y continúan haciendo notar que “Las pruebas en paralelo han sido y siguen suponiendo un gran impulsor de la reducción de costes … “

Al igual que la investigación ha demostrado que los seres humanos se enfrentan a ineficiencias en las actividades multitarea del día a día de trabajo, los sistemas experimentan una sobrecarga al realizar pruebas en paralelo.

En las pruebas de semiconductores, los directores de pruebas utilizan la eficiencia de las pruebas en paralelo (PTE: Parallel Test Efficiency) de un sistema de pruebas para medir la sobrecarga. Si el software de prueba posee una arquitectura adecuada, el incremento de los núcleos de procesamiento disponibles en un sistema de prueba debe afectar positivamente al PTE para una rutina de prueba dada. Aunque los administradores de las pruebas deben tener en cuenta muchos factores, tales como el espacio en la planta, el rendimiento óptimo en partes por hora y los gastos de capital al invertir en sistemas de pruebas automatizadas, una actualización de la potencia de procesamiento paralelo del sistema tiene normalmente un impacto positivo en el negocio mediante la mejora del PTE.

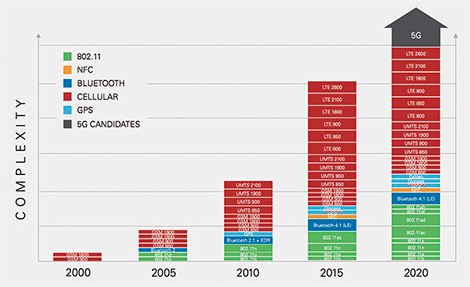

Pero la industria de los semiconductores no está sola en la adopción de las pruebas en paralelo. Uno se sentiría en apuros para encontrar un sistema de pruebas inalámbricas que pruebe menos de cuatro dispositivos a la vez. Los procesadores con muchos núcleos están también preparados para causar impacto en cualquier industria que deba probar la conectividad inalámbrica o los protocolos de comunicación celular de un dispositivo.

No es ningún secreto que el 5G está siendo investigado y se están creando prototipos en la actualidad, y esta tecnología también superará la capacidad de ancho de banda de la instrumentación de RF actual. Además de procesar todos los datos que se envían desde el analizador de señal de elevado ancho de banda con un único protocolo, los sistemas de prueba inalámbricos deben probar múltiples protocolos en paralelo.

Por ejemplo, un fabricante de teléfonos inteligentes necesita probar no sólo el 5G cuando se lance en un próximo futuro, sino también la mayoría de las tecnologías celulares anteriores, como Bluetooth, 802.11 y cualquiera de otras variantes de conectividad. Y, en términos generales, cada nuevo protocolo de comunicación requiere algoritmos de prueba que están más sedientos de procesadores que su predecesor. Así como los procesadores de múltiples núcleos ayudan a aumentar el PTE de un sistema de prueba de semiconductores, el incremento de la proporción entre núcleos de procesamiento, protocolos y dispositivos bajo prueba ayudará a reducir aún más el tiempo de prueba.

El software de la aplicación

El software ha evolucionado desde constituir un componente menor a ejercer un papel de liderazgo en la prueba y medida. Con el cambio mencionado en el mercado de las CPUs, los ingenieros de prueba se enfrentan ahora al reto aún más difícil de tratar de poner en práctica las arquitecturas en paralelo del software de prueba.

Cuando se utiliza un lenguaje de programación de propósito general como C o C++, la correcta aplicación de las técnicas de prueba en paralelo requiere a menudo meses-hombre de desarrollo. Cuando el tiempo de comercialización es una prioridad, los directores e ingenieros de las pruebas deben enfatizar la productividad del desarrollador. La adopción de software de desarrollo del código de prueba específico para la aplicación (por ejemplo, NI LabVIEW) y el software de gestión de pruebas (por ejemplo, NI TestStand) mueve el trabajo administrativo del procesamiento e hilado en paralelo intercambiándolo desde los departamentos de la prueba al personal de I+D de software de la empresa de software comercial. El software específico para la aplicación permite a los ingenieros de prueba centrarse en el código que es fundamental para probar sus dispositivos.

Preparación para el futuro

La complejidad ha aumentado a un ritmo extraordinario durante la última década y no muestra signos de desaceleración. La próxima generación de la comunicación celular está pensada para que llegue en 2020. Gartner estima que todos los hogares del mundo tendrán más de 500 dispositivos conectados para el año 2022, y los sensores serán probablemente menores que el diámetro de un cabello humano. Las expectativas de crecimiento del consumo de productos de alta calidad por parte de los usuarios exigen que los fabricantes diseñen y prueben vigorosamente sus productos para ser competitivos. Se requerirá que los ingenieros de prueba prueben estos productos y garanticen que funcionan de forma segura y fiable.

Para lograr económicamente esto, tendrán que adoptar un enfoque modular centrado en el software que haga énfasis en las pruebas en paralelo. La utilización de la tecnología de procesamiento de múltiples núcleos ya no es una opción; es ahora un requisito para mantenerse económicamente viable. La única cuestión pendiente es cómo los departamentos de la prueba van a cambiar el enfoque de su software para aprovechar los núcleos de procesamiento adicionales.