La industria de la IA se encuentra en un punto de inflexión. Durante años, los avances en el aprendizaje profundo (deep learning) han estado impulsados por modelos masivos y patentados entrenados en la nube, lo que ha convertido la adopción de la IA en una tarea costosa y centralizada. Sin embargo, se está produciendo un nuevo cambio que hace hincapié en la apertura, la eficiencia y la escalabilidad, especialmente para el edge computing.

DeepSeek, un modelo emergente de IA de «peso abierto» (open-weight), es un potente ejemplo de esta tendencia. Su desarrollo pone de relieve el creciente movimiento hacia la democratización de la IA, proporcionando a los desarrolladores y a las empresas nuevas formas de implementar la inteligencia en todos los dispositivos sin las limitaciones de los modelos propietarios basados en la nube.

Con el último lanzamiento de DeepSeek-R1, esta tendencia se está acelerando. DeepSeek-R1 se entrena mediante aprendizaje por refuerzo a gran escala a partir de la retroalimentación humana (RLHF-Reinforcement Learning from Human Feedback), lo que le permite desarrollar sólidas capacidades de razonamiento de forma autónoma. Los resultados de las pruebas de referencia muestran que su rendimiento es similar al de OpenAI-o1-1217 en tareas como matemáticas, codificación y recuperación de conocimientos fácticos. Además, DeepSeek-R1 incluye versiones simplificadas (1,5B, 7B, 14B, 32B, 70B) optimizadas para la eficiencia, lo que lo hace muy relevante para el edge computing.

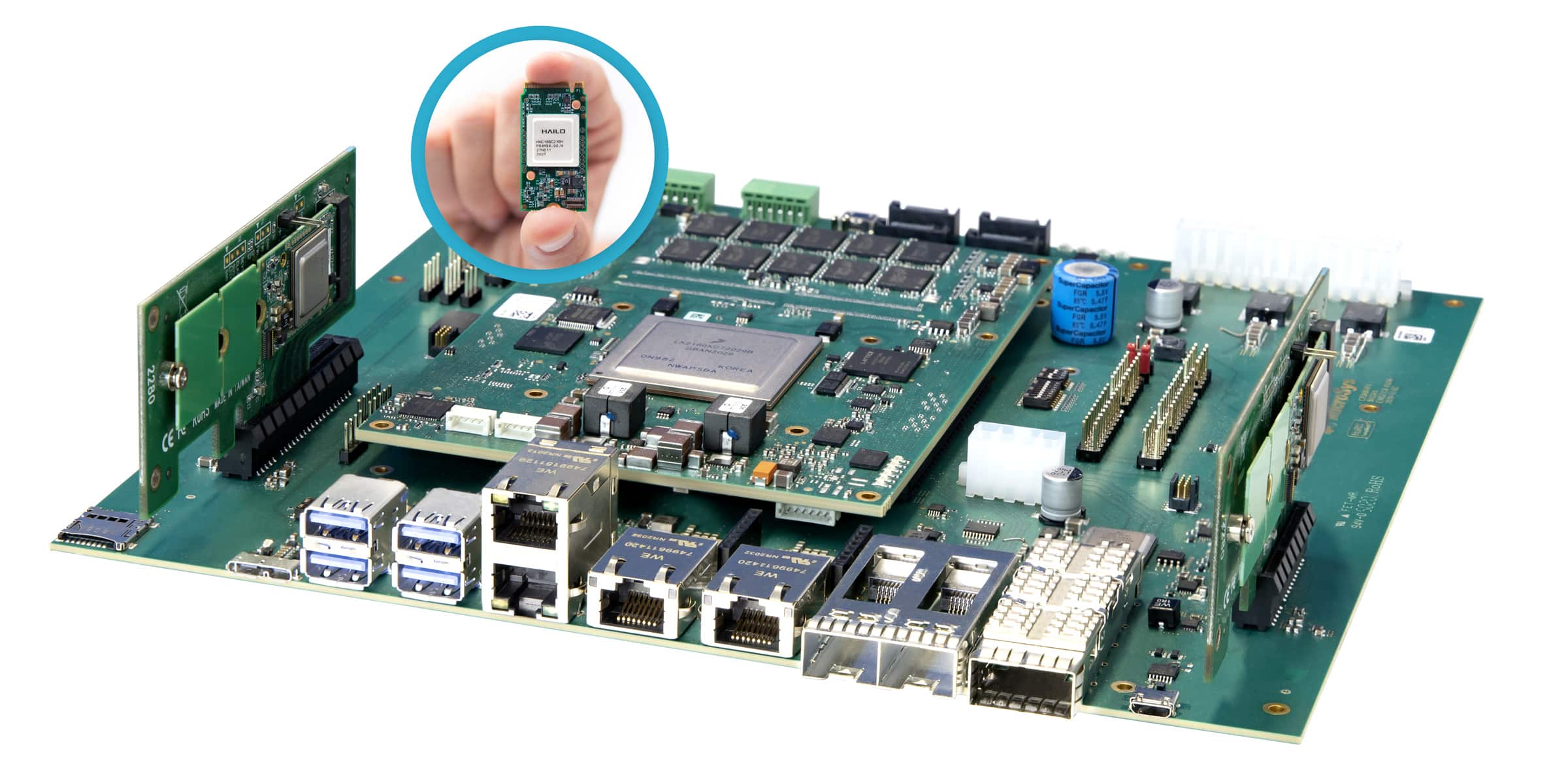

Pero los modelos de IA de peso abierto por sí solos no son suficientes. Para que la IA en el edge alcance su máximo potencial, se necesitan plataformas informáticas eficientes y nativas de IA que puedan manejar estos modelos en entornos del mundo real. Aquí es donde las innovaciones en MPsU y MCUs de bajo consumo y alto rendimiento, como nuestra plataforma Astra, desempeñan un papel crucial.

El reto del cálculo de IA: más allá de la nube

Las cargas de trabajo de IA actuales están cada vez más limitadas por las demandas de cálculo o computación. El modelo dominante de implementación de IA se ha centrado en la inferencia en la nube a gran escala, donde modelos como GPT-4 o Gemini requieren enormes clústeres de GPU para funcionar con eficacia. Si bien este enfoque funciona para aplicaciones centralizadas, resulta poco práctico para casos de uso basados en el edge, como cámaras inteligentes, automatización industrial y dispositivos IoT inteligentes que necesitan procesamiento en tiempo real y autonomía.

Este reto ha impulsado la demanda de modelos de IA eficientes que puedan ejecutarse más cerca de la fuente de datos, minimizando la latencia, el consumo de energía y las dependencias de conectividad, al tiempo que mejoran la seguridad y la privacidad. Los modelos de peso abierto como DeepSeek-R1 son un paso en la dirección correcta, pero deben combinarse con el silicio adecuado habilitado para IA para liberar todo su potencial.

¿Por qué son importantes los modelos de IA de peso abierto como DeepSeek?

DeepSeek forma parte de un movimiento más amplio hacia la innovación en IA abierta, siguiendo los pasos de modelos como LLaMA y Mistral. Al ofrecer transparencia y flexibilidad de personalización, los modelos de peso abierto permiten a los desarrolladores:

- Ajustar la IA para aplicaciones especializadas (por ejemplo, IoT industrial, automoción, robótica).

- Reducir la dependencia de los proveedores de nube para la inferencia, lo que reduce los costes y aumenta el control.

- Optimizar el rendimiento para implementaciones en el edge, donde los recursos informáticos son limitados.

Con DeepSeek-R1, este movimiento está evolucionando aún más. El enfoque de simplificación utilizado en R1 permite crear modelos más pequeños y eficientes que siguen conservando una alta capacidad de razonamiento. Esto es fundamental para la IA en el edge, donde las limitaciones de potencia y memoria hacen inviable la implementación de modelos grandes.

IA en el edge: la optimización de la computación y los modelos van de la mano

Los modelos de IA abiertos como DeepSeek-R1 son solo una parte de la ecuación. Para que la IA sea realmente viable en el edge, necesitamos hardware diseñado para manejar estos modelos de manera eficiente y rentable.

En Synaptics, hemos creado la plataforma Astra teniendo en cuenta precisamente este reto. Astra es una plataforma informática nativa de IA diseñada para la inferencia de IA multimodal y eficiente en términos de consumo energético en dispositivos embebidos e IoT. Al aprovechar los procesadores Arm(R) Cortex(R)-A y la aceleración de IA estrechamente integrada, Astra permite el procesamiento de IA en tiempo real en el edge, sin necesidad de descargar datos a la nube.

Los modelos simplificados de DeepSeek-R1 son el complemento ideal para este enfoque. Estos modelos mantienen un alto rendimiento en tareas de razonamiento, al tiempo que reducen significativamente los requisitos de cálculo, lo que los hace muy adecuados para dispositivos edge con IA nativa. Esta sinergia entre los modelos de IA abiertos, la simplificación y el edge computing optimizada definirá la próxima fase de la innovación en IA. Imagine un mundo en el que:

- Los dispositivos domésticos inteligentes pueden procesar las interacciones de los usuarios de forma local, preservando la privacidad y reduciendo la latencia.

- Los sensores industriales aprovechan la IA para detectar anomalías en tiempo real, evitando costosos tiempos de inactividad.

- Los dispositivos médicos impulsados por IA proporcionan diagnósticos en tiempo real sin necesidad de conectarse a la nube.

Estos son los tipos de aplicaciones en los que los modelos de IA de peso abierto y los procesadores nativos de IA redefinirán lo que es posible

El futuro: impulsar la innovación en IA a través de la apertura y la eficiencia

A medida que se acelera la adopción de la IA, la industria está reconociendo que los modelos propietarios y centrados en la nube por sí solos no serán suficientes. La IA de peso abierto, como DeepSeek-R1, representa un cambio fundamental hacia una inteligencia escalable, personalizable y eficiente, pero para llevar realmente la IA a todas partes, necesitamos plataformas informáticas diseñadas para las limitaciones del mundo real.

En Synaptics, estamos entusiasmados con esta transformación. La combinación de modelos de IA abiertos, técnicas de simplificación y computación nativa de IA dará forma al futuro de la inteligencia periférica, lo que permitirá a los desarrolladores, las empresas y las industrias implementar la IA de formas que antes eran imposibles.

Sigamos con la conversación. ¿Cuál cree que es el mayor reto a la hora de llevar la IA al periférico? Visite el sitio web de Synaptics website para descubrir cómo estamos haciendo realidad la computación nativa de IA.